ผู้เชี่ยวชาญกล่าวเมื่อวันพุธ (4 มี.ค.) ว่า “การใช้ปัญญาประดิษฐ์ (AI) อย่างแพร่หลายในการเลือกเป้าหมายและโจมตีอิหร่านนั้น ก่อให้เกิดคำถามและความกังวลมากมายว่า ‘มนุษย์กำลังสูญเสียการควบคุมเครื่องจักรสงคราม?’”

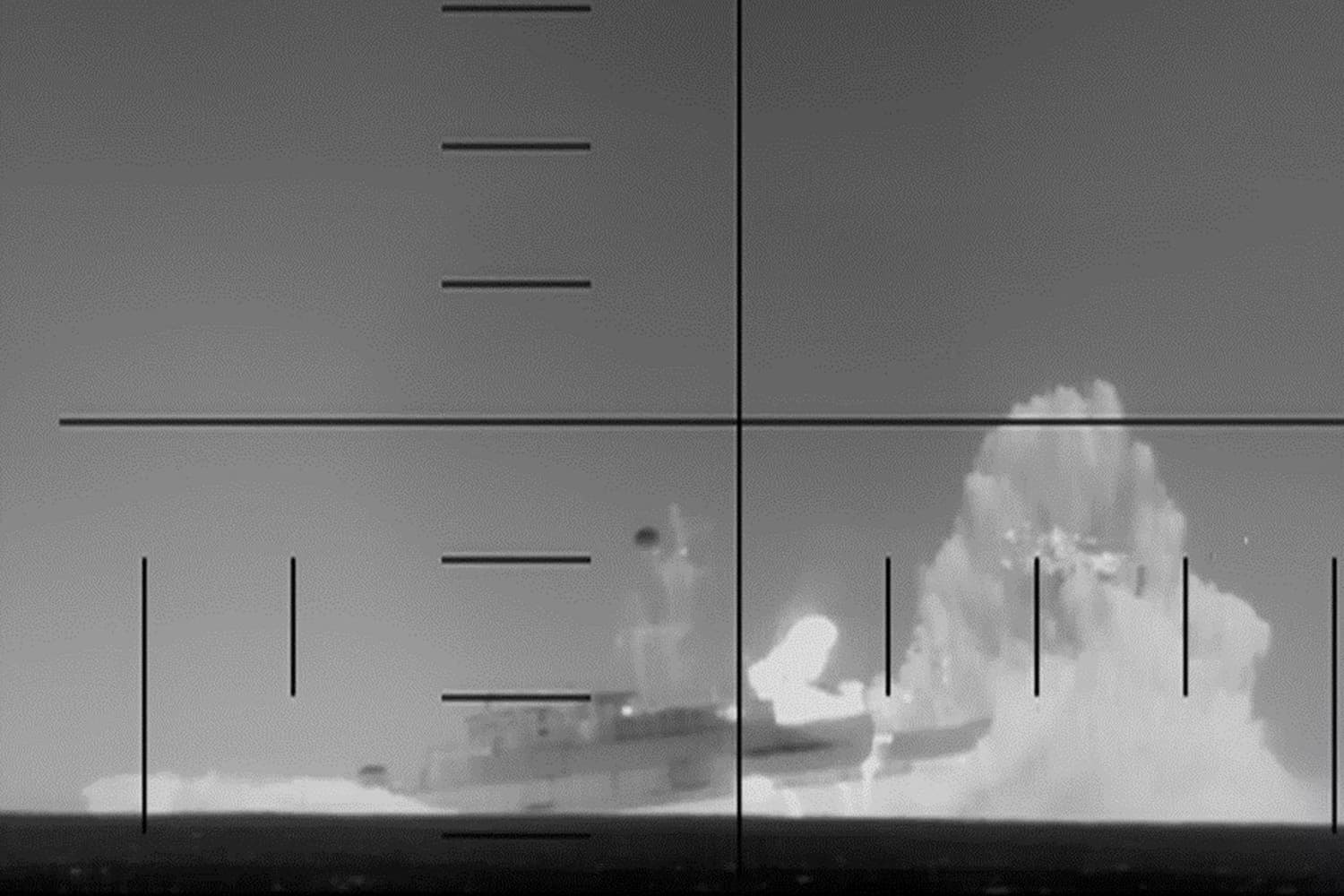

สหรัฐฯ และอิสราเอลได้โจมตีอิหร่านหลายพันครั้งนับตั้งแต่เริ่มปฏิบัติการ รวมถึงการโจมตีที่สังหารอยาตอลลาห์ อาลี คาเมเนอี ผู้นำสูงสุดของอิหร่านเมื่อวันเสาร์ (28 ก.พ.) ซึ่งเป็นวันแรกของสงคราม

ปีเตอร์ อัสซาโร รองศาสตราจารย์ผู้เชี่ยวชาญด้านปัญญาประดิษฐ์-หุ่นยนต์ และรองประธานแคมเปญ ‘Stop Killer Robots’ กล่าวว่า “ดูเหมือนว่าทั้งสองประเทศจะใช้ AI ในการระบุเป้าหมายในอิหร่าน” โดยชี้ให้เห็นถึงขั้นตอนการวางแผนที่ใช้เวลาสั้นมากและสามารถระบุจำนวนเป้าหมายได้หลายเป้า “แต่ในขณะที่ AI สามารถเร่งความเร็วได้ มันก็ยังก่อให้เกิดคำถามทางศีลธรรมและกฎหมายมากมายเช่นกัน”

“ระบบอัตโนมัติสามารถสร้างรายการเป้าหมายจำนวนมากได้อย่างรวดเร็วกว่าที่มนุษย์จะทำได้ แต่ปัญหาคือ มนุษย์เหล่านั้นตรวจสอบเป้าหมายเฉพาะที่ถูกลิสต์ไว้จริงแค่ไหน ว่าถูกต้องตามกฎหมายและมีคุณค่าทางทหารก่อนอนุมัติหรือไม่?...เป้าหมายของระบบ AI ทั้งหมดคือการตัดสินใจและเคลื่อนไหวเร็วกว่าศัตรู แต่คำถามสำคัญคือ คุณยังควบคุมสิ่งที่เกิดขึ้นได้จริงๆ อยู่หรือเปล่า?”

— รองศาสตราจารย์อัสซาโร กล่าว

มีการหารือกันมานานกว่าทศวรรษเกี่ยวกับสนธิสัญญาในอนาคตที่เป็นไปได้เพื่อควบคุมการใช้อาวุธอัตโนมัติ และปลายปีนี้ประเทศต่างๆ จะต้องตัดสินใจว่าจะเริ่มการเจรจาสนธิสัญญาอย่างเป็นทางการหรือไม่ แม้ยังไม่มีสนธิสัญญาเฉพาะเกี่ยวกับ AI และอาวุธอัตโนมัติ แต่ไม่ได้หมายความว่าระบบเหล่านี้ทำงานอยู่ในสุญญากาศทางกฎหมาย เพราะกฎหมายระหว่างประเทศที่มีอยู่แล้วยังใช้บังคับได้

รองศาสตราจารย์อัสซาโร กล่าวในระหว่างการประชุมนอกรอบที่สหประชาชาติในเจนีวาว่า “ส่วนสำคัญของการอภิปรายอยู่ที่การเลือกเป้าหมาย” และเขากังวลว่า “การควบคุมโดยมนุษย์อย่างแท้จริงอาจสูญหายไป”

ในขณะที่คำโฆษณาชวนเชื่อสำหรับการใช้ AI ในสงครามมักจะบอกว่า “สิ่งเหล่านี้มีความแม่นยำสูงและทำผิดพลาดน้อยกว่ามนุษย์ เราไม่รู้จริงๆ ว่าระบบเหล่านี้ทำงานอย่างไร...AI ทำงานบนระบบลับที่ไม่โปร่งใส ทำให้แทบไม่มีข้อมูลเชิงลึกเกี่ยวกับวิธีการทำงานและวิธีการตัดสินใจ”

“มันไม่มีวิธีง่ายๆ ในการประเมินผลลัพธ์ของระบบเหล่านี้ หรือตรวจสอบว่าผิดพลาดตรงไหนเมื่อเกิดข้อผิดพลาด ถ้ามีอะไรผิดพลาด ใครจะเป็นผู้รับผิดชอบ? คุณจะกำหนดสิ่งนี้ในทางกฎหมายได้อย่างไร เส้นแบ่งทางศีลธรรมอยู่ตรงไหน?”

— รองศาสตราจารย์อัสซาโร ตั้งข้อสังเกต

รองศาสตราจารย์อัสซาโรยกตัวอย่างกรณีโรงเรียนในเมืองมินาบที่ถูกโจมตีเมื่อวันเสาร์ (28 ก.พ.) ทำให้มีผู้เสียชีวิตมากกว่า 150 คน ซึ่งทางอิหร่านออกมากล่าวโทษสหรัฐฯ และอิสราเอล แต่ทั้งสองประเทศยังไม่ยืนยันการโจมตี และไม่สามารถตรวจสอบจำนวนผู้เสียชีวิตได้อย่างอิสระ หรือไม่สามารถไปตรวจสอบสถานที่เกิดเหตุได้

สำนักข่าว AFP ยืนยันว่าอาคารดังกล่าวตั้งอยู่ใกล้กับสถานที่ 2 แห่งที่อยู่ภายใต้การควบคุมของกองกำลังพิทักษ์ปฏิวัติอิสลาม (IRGC) ที่ทรงอิทธิพล

อย่างไรก็ดี รองศาสตราจารย์อัสซาโรเน้นย้ำรายงานเกี่ยวกับการโจมตีที่ระบุว่า “โรงเรียนนั้นแยกออกจากฐานทัพทหารที่อยู่ติดกันอย่างชัดเจนมาอย่างน้อยหนึ่งทศวรรษแล้ว...หากมีความผิดพลาดเกิดขึ้น ก็ยังไม่ชัดเจนว่าอะไรเป็นสาเหตุ พวกเขาไม่ได้แยกโรงเรียนออกจากฐานทัพอย่างที่ควรจะทำ แต่ว่าเป็นฝีมือใครกัน? มนุษย์ หรือเครื่องจักร?”

“หากมีการใช้ AI ในการโจมตี คำถามคือ ‘ข้อมูลนั้นเก่าแค่ไหน?’ และนี่เป็นข้อผิดพลาดของฐานข้อมูลหรือไม่? หรือการกำหนดเป้าหมายนั้นแม่นยำ แต่แค่พลาดเป้าไป? มีหลายวิธีที่สิ่งต่างๆ อาจล้มเหลวได้...อีกความเป็นไปได้หนึ่งที่อาจน่ากลัวกว่านั้นก็คือ ‘ระบบ AI อาจสรุปว่า...โรงเรียนเป็นภัยคุกคาม”

— รองศาสตราจารย์อัสซาโร กล่าว

รองศาสตราจารย์อัสซาโร กล่าวทิ้งท้ายว่า “ถ้า AI ตัดสินว่าโรงเรียนเป็นภัยคุกคาม จะนำไปสู่การตั้งคำถามที่ใหญ่กว่านั้นว่า ‘ระบบการให้เหตุผลเบื้องหลังการสรุปนั้นคืออะไร’ คุณต้องกังวลจริงๆ ว่าระบบตัดสินใจยังไง”

(Photo by US DEPARTMENT OF DEFENSE / AFP)